La proliferazione delle foto e dei video generati da AI sta divertendo tutti noi, e molte questioni si pongono, al di là del divertimento che proviamo.

Al primo punto c’è naturalmente la preoccupazione sulla riconoscibilità di questi artefatti. E’ una questione di grande rilevanza, perchè la diffusione di foto o video generati da AI è funzionale alla disinformazione, condotta da attori statali o proxy. La disinformazione sul web utilizza oggi ampiamente questi strumenti, e ne abbiamo esempi ogni giorno. Il tema è tanto importante che la regolamentazione europea sull’AI (AI Act) lo ha regolamentato, nell’Art. 50 sulla Trasparenza. Purtroppo questa normativa vale solo per i cittadini dell’Unione, anche se molti altri paesi stanno seguendo il nostro esempio.

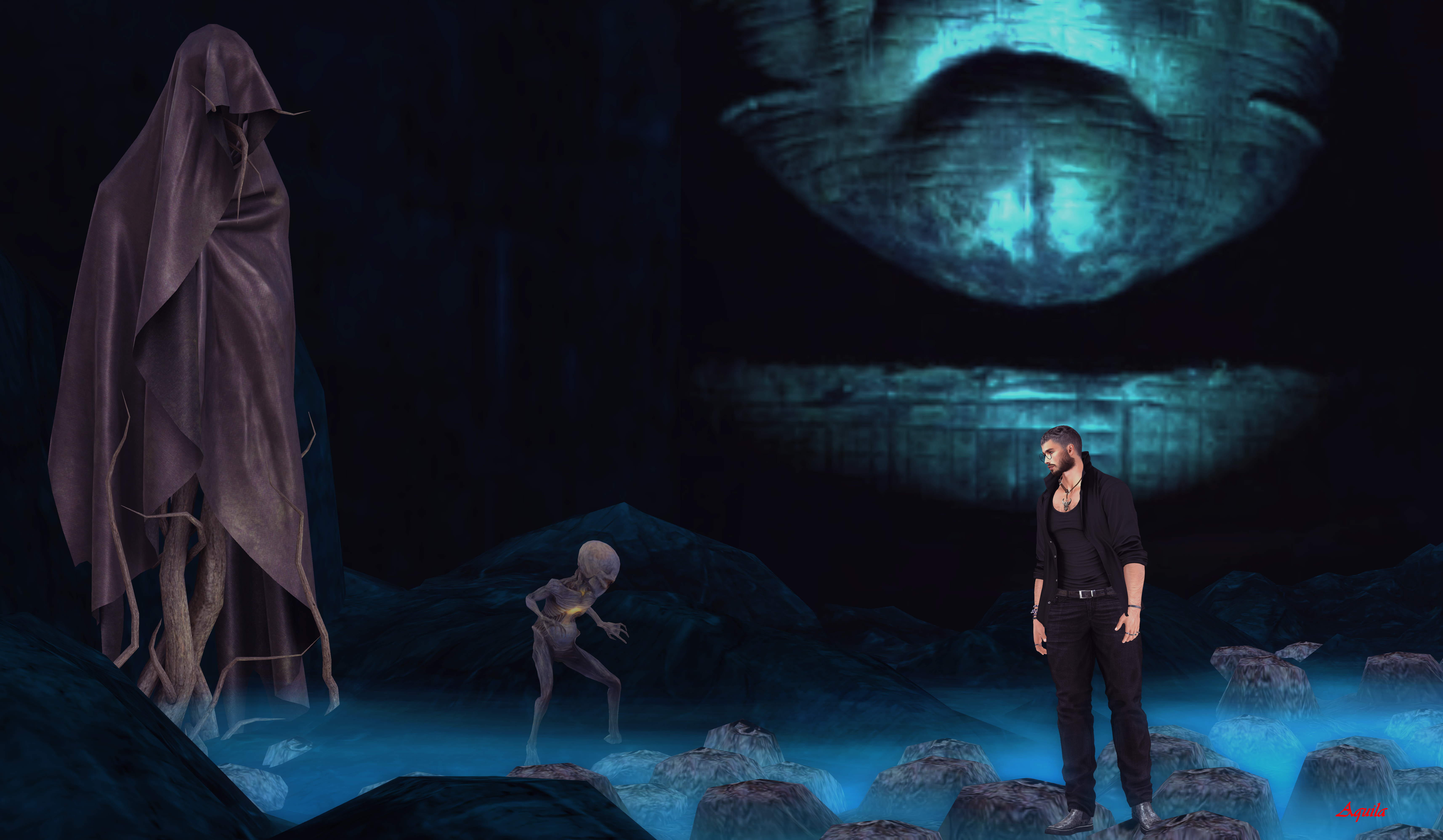

Una delle più famose immagini Fake create con AI

Lasciando da parte questa questione, che impatta su temi di carattere normativo e sociale, il tema che interessa noi produttori di contenuti, è invece è quello della creatività e dell’attribuzione di un’opera, una foto ad esempio. I prodotti di AI ci consentono di creare una foto, o un video, solo basandoci su una descrizione testuale (“prompt”) o anche partendo da una o più foto di riferimento, che completiamo poi con le indicazioni dettagliate del prompt.

Il risultato, a volte scadente, ma altre davvero eccezionale, a seconda del prodotto utilizzato, è una creazione complessa, che non possiamo attribuire a noi, ma neanche all’AI. Si tratta del nuovo modo di utilizzare i modelli generativi, non solo foto o video, ma anche testo. Molti degli articoli, e anche interi libri, che vedete in giro, sul mercato, sui giornali e sul web, sono stati prodotti utilizzando gli LLM (GPT, Gemini, Claude, ecc.).

Questo nuovo modo di lavorare implica una collaborazione, tra il creatore umano e il creatore artificiale. L’AI non genera da solo quel prodotto, non saprebbe cosa fare, ma segue le indicazioni che gli diamo noi attraverso i prompt o anche usando delle nostre foto come riferimento. Spesso questo processo richiede ore di lavoro, quindi è effettivamente un lavoro fatto da noi umani, e dai nostri “team-mate” artificiali.

Immagine di una ragazza generata a partire da un Avatar

E’ meglio? E’ peggio? No, è diverso. Quando cominciammo a riprendere paesaggi e persone utilizzando le macchine fotografiche, ci ponemmo il problema se fossero meglio le foto che stavamo scattando o i quadri, creati dai grandi paesaggisti? E che dire della scrittura, che fu criticata addirittura da Platone (intorno al 370 a.C.), nella sua opera “Fedro” ? Platone sosteneva che la parola scritta avrebbe indebolito la nostra memoria, ci avrebbe reso pigri, impedendo ai giovani di apprendere. Non solo, ma Platone sosteneva che si sarebbe creata l’illusione della conoscenza solo leggendo le cose, senza approfondirle. Sembra di leggere argomenti di pressante attualità, sollevati dall’utilizzo degli LLM, i modelli di AI Generativa del linguaggio. Tanto che è stata creata, da ricercatori italiani, una nuova parola per definire questo effetto: “Epistemia“. Un termine che ha fatto il giro del mondo.

Tornando all’utilizzo dei prodotti di AI generativa per i contenuti, si tratta semplicemente dell’avanzamento della scienza, e della tecnologia che l’accompagna, che mette a nostra disposizione strumenti sempre nuovi, in particolare negli ultimi anni. E noi siamo costretti oggi a rincorrere il progresso, che ha assunto una velocità evolutiva esponenziale, per capire prima, e per usare poi, la nostra cassetta degli attrezzi, che si riempie continuamente di nuovi strumenti, che siano la scrittura, la stampa, la macchina fotografica, o l’Intelligenza artificiale.

Quindi, in conclusione, le opere che creiamo noi utilizzando i modelli generativi di Intelligenza Artificiale sono sempre creati da noi, col nostro pensiero soprattutto, la nostra idea che vogliamo realizzare, ma anche con questi nuovi strumenti che abbiamo a disposizione. Come sempre è successo nella storia, del resto…

Un saluto a tutti.